Растет гонка вооружений между изображениями с искусственным интеллектом (ИИ) и методами, используемыми для их обнаружения. Последнее достижение в области обнаружения пришло из астрономии. Сложные методы, используемые для препарирования и понимания света в астрономических изображениях, могут быть использованы и для дипфейков.

Слово «deepfakes» — это гибрид слов «deep learning» и «fakes». Изображения Deepfake так называются, потому что они созданы с помощью определенного типа ИИ, называемого глубоким обучением, которое само по себе является подмножеством машинного обучения. ИИ с глубоким обучением может довольно хорошо имитировать что-то, если ему показать много примеров того, что его просят подделать. Когда дело доходит до изображений, deepfakes обычно подразумевает замену существующего лица на изображении лицом второго человека, чтобы создать впечатление, что кто-то другой находится в определенном месте, в компании определенных людей или занимается определенными видами деятельности.

Дипфейки становятся все лучше и лучше, как и другие формы ИИ. Но, как оказалось, новый инструмент для обнаружения дипфейков уже существует в астрономии. Астрономия — это все о свете, и наука о том, как вычленять мельчайшие детали в свете от чрезвычайно далеких и загадочных объектов, развивается так же быстро, как и ИИ.

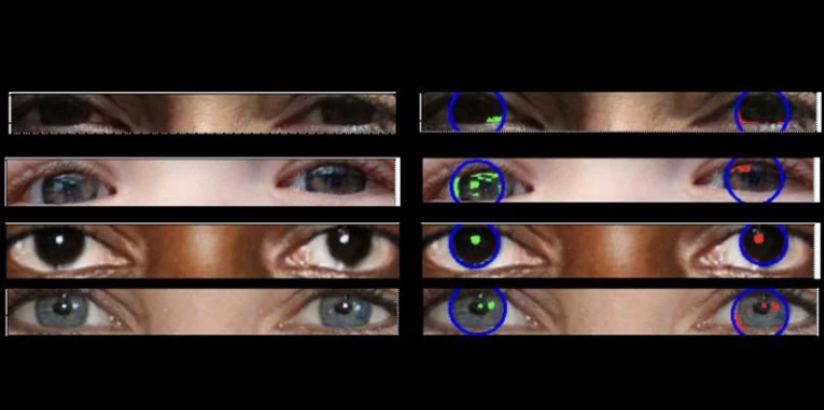

В новой статье в Nature научный журналист Сара Уайлд рассмотрела, как исследователи используют астрономические методы для обнаружения дипфейков. Адеджумок Оволаби — студентка Университета Халла в Великобритании, которая изучает науку о данных и компьютерное зрение. Ее магистерская диссертация посвящена тому, как свет, отраженный в глазных яблоках, должен быть постоянным, хотя и не идентичным, между левым и правым глазом. Оволаби использовала высококачественный набор данных человеческих лиц из Flickr, а затем использовала генератор изображений для создания поддельных лиц. Затем она сравнила их, используя две разные астрономические системы измерений, называемые системой CAS и индексом Джини, чтобы сравнить свет, отраженный в глазных яблоках, и определить, какие из них являются дипфейками.

CAS означает концентрацию, асимметрию и гладкость, и астрономы десятилетиями использовали его для изучения и количественной оценки света от внегалактических звезд. Он также используется для количественной оценки света от целых галактик и проник в биологию и другие области, где изображения необходимо тщательно изучать. Известный астрофизик Кристофер Дж. Конселис был ключевым сторонником использования CAS в астрономии.

Индекс Джини, или коэффициент Джини, также используется для изучения галактик. Он назван в честь итальянского статистика Коррадо Джини, который разработал его в 1912 году для измерения неравенства доходов. Астрономы используют его для измерения того, как свет распространяется по галактике и является ли он однородным или концентрированным. Это инструмент, который помогает астрономам определять морфологию и классификацию галактики.

В своем исследовании Оволаби успешно определила, какие изображения были поддельными в 70% случаев.

Для своей статьи Уайлд поговорила с Кевином Пимблетом, директором Центра передового опыта в области науки о данных, искусственного интеллекта и моделирования в Университете Халла в Великобритании. Пимблетт представил исследование на Национальной астрономической встрече Королевского астрономического общества Великобритании 15 июля.

«Это не панацея, потому что у нас есть ложные положительные и ложные отрицательные результаты», — сказал Пимблет. «Но это исследование дает потенциальный метод, важный шаг вперед, возможно, чтобы добавить к батарее тестов, которые можно применить, чтобы попытаться выяснить, является ли изображение реальным или поддельным».

Это многообещающее развитие. Открытые демократические общества подвержены дезинформационным атакам со стороны врагов извне и изнутри. Публичные деятели подвержены аналогичным атакам. Тревожно, что большинство дипфейков являются порнографическими и могут изображать публичных деятелей в частных и иногда унизительных ситуациях. Все, что может помочь бороться с этим и укрепить гражданское общество, является желанным инструментом.

Но как мы знаем из истории, гонки вооружений не имеют конечной точки. Они продолжаются и продолжаются в эскалационной серии контрмер. Посмотрите, как США и СССР продолжали превосходить друг друга во время гонки ядерных вооружений, когда размеры боеголовок достигли абсурдных уровней разрушительной силы. Так что, поскольку эта работа выглядит многообещающей, поставщики дипфейков извлекут из нее уроки и улучшат свои методы дипфейков ИИ.

В своей статье Уайлд также пообщалась с Брантом Робертсоном. Робертсон — астрофизик из Калифорнийского университета в Санта-Крузе, который изучает астрофизику и астрономию, включая большие данные и машинное обучение. «Однако, если вы можете вычислить метрику, которая количественно определяет, насколько реалистичным может выглядеть изображение deepfake, вы также можете обучить модель ИИ производить еще более качественные deepfake, оптимизировав эту метрику», — сказал он, подтвердив то, что многие могут предсказать.

Это не первый случай, когда астрономические методы пересекаются с земными проблемами. Когда был разработан космический телескоп Хаббл, он содержал мощный ПЗС (прибор с зарядовой связью). Эта технология вошла в систему цифровой маммографической биопсии. Система позволила врачам делать более качественные снимки тканей молочной железы и определять подозрительные ткани без физической биопсии. Теперь ПЗС лежат в основе всех наших цифровых камер, в том числе и на наших мобильных телефонах.

Могут ли наши интернет-браузеры однажды содержать детектор deepfake на основе Gini и CAS? Как это будет работать? Будут ли враждебные субъекты атаковать эти детекторы, а затем заполонить наши СМИ изображениями deepfake в попытке ослабить наши демократические общества? Такова природа гонки вооружений.

В нашей природе также заложено использовать обман, чтобы влиять на события. История показывает, что правители со злыми намерениями могут легче обманывать население, находящееся во власти сильных эмоций. ИИ-дипфейки — это всего лишь новейший инструмент в их распоряжении.

Мы все знаем, что у ИИ есть недостатки, и дипфейки — один из них. Хотя их законность неясна, как и в случае со многими новыми технологиями, мы начинаем видеть усилия по борьбе с ними. Правительство Соединенных Штатов признает эту проблему, и было предложено несколько законов для ее решения. «Закон об ответственности за дипфейки» был внесен в Палату представителей США в сентябре 2023 года. «Закон о защите потребителей от обманчивого ИИ» — еще одно связанное предложение. Оба пока барахтаются в порой мутном мире подкомитетов, но они могут выйти на поверхность и в конечном итоге стать законом. Другие страны и ЕС борются с той же проблемой.

Однако в отсутствие всеобъемлющей правовой базы, регулирующей дипфейки с использованием ИИ, и даже после того, как таковая будет создана, обнаружение по-прежнему остается ключевым фактором.

Астрономия и астрофизика могли бы стать неожиданными союзниками в борьбе с ними.